患者がAIチャットボットでメンタルヘルスの相談をしている。

そんな場面が、もはや珍しくない時代になりました。

しかし、臨床家の多くはAIツールへの対応準備が十分ではありません。

本記事では、Psychiatric Timesの提言をもとに、チャットボット時代に臨床家が身につけるべき能力と、その実践方法を解説します。

なぜ今、臨床家にAIリテラシーが必要なのか?

AIリテラシーとは、AIツールの仕組み・限界・適切な使い方を理解し、臨床現場で安全に活用できる能力のことです。

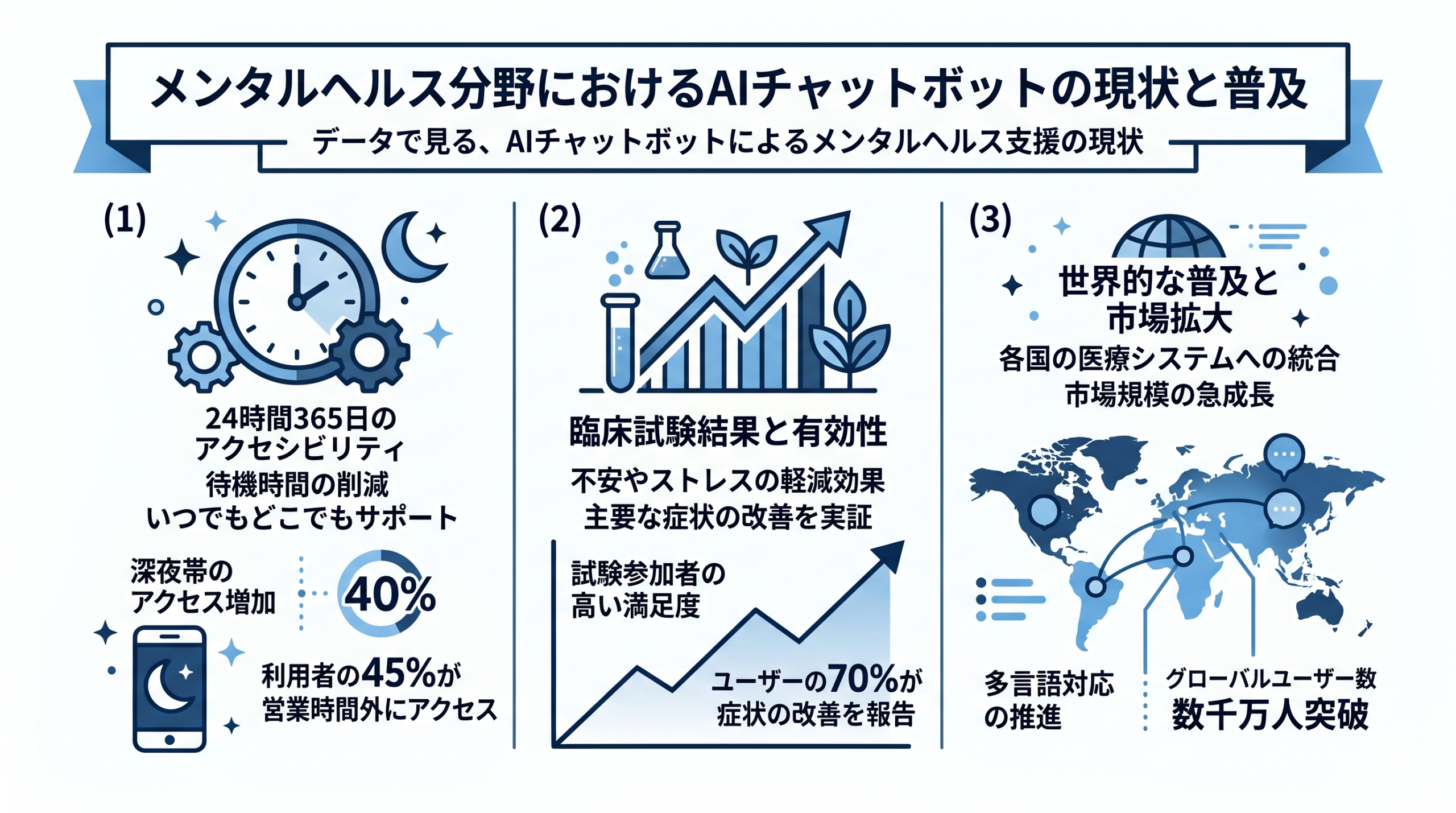

メンタルヘルス領域では、AIチャットボットの普及が加速しています。

ダートマス大学の研究チームが開発した「Therabot」は、2025年に発表された初の臨床試験で、うつ病や不安症の治療において人間のセラピストと同等の効果を示しました。

また、イギリスのNHSで導入された「Limbic Care」は、認知行動療法(CBT)のスキルをベースに、患者への直接的なサポートを提供しています。

こうしたツールは24時間利用可能で、利用者に評価や偏見を与えず、安心して感情を表出できる環境を提供できます。

たとえば、深夜に不安発作が起きたとき、すぐに対話できる相手がいるイメージです。

一方で、急速な普及は重大な問題も生んでいます。

一般向けAIチャットボットを利用した結果、悲劇的な事態が発生した事例も報告されており、米国では、子どもの自傷行為や自殺に生成AIが関与したとして訴えを起こす家族が相次いでいます。

臨床家がAIの特性を理解せずにいると、患者を適切に導くことができません。

これが、AIリテラシーが急務とされる理由です。

臨床家に求められる5つのAIコンピテンシーとは?

Psychiatric Timesの論考では、精神科医のトレーニングにおいて、以下の能力領域を強化すべきだと提言されています。

| 能力領域 | 概要 | 具体例 |

| 1. チャットボットリテラシー | AIチャットボットの仕組み・種類・限界を理解する力 | ルールベース型とLLM型の違いを説明できる。患者に「チャットボットにできること・できないこと」を伝えられる |

| 2. 臨床インテークでのチャットボット使用評価 | 患者がどのようにチャットボットを使っているかを臨床評価に組み込む能力 | 睡眠、薬物使用、あるいはソーシャルメディアの行動を評価するのと同様に、チャットボットの使用について、問診票やスクリーニングプロトコルに、AIツールの使用に関する構造化された質問を追加する |

| 3. 安全性の確保 | AI利用に伴うリスクを予見し、患者の安全を守る力 | 自殺リスクのある患者がチャットボットだけに頼ることの危険性を認識し、適切にトリアージ(緊急度の判断・振り分け)できる |

| 4. 倫理的判断力 | プライバシー・バイアス・インフォームドコンセントなどの倫理的課題に対応する力 | 患者データがAIサービスにどう使われるかを把握し、説明できる |

| 5. AI統合スキル | AIツールを既存の臨床ワークフローに安全かつ効果的に組み込む力 | 治療のどの段階でAIを補助的に使うべきかを判断し、ハイブリッドモデルを設計できる |

チャットボットの利用にはどんなリスクがあるのか?

AIチャットボットは、常に利用可能だが、危険信号を見落とす可能性があるツールです。

友人なら気づくような異変に、チャットボットは気づけないことがあります。

最も深刻なリスクは、自殺リスクの評価における限界です。

精神科臨床では、自殺念慮はしばしば否認されたり隠されたりします。

経験ある臨床医は、言語化されない微妙なサイン(表情の変化、話題の回避、声のトーンなど)から危険を察知できますが、テキストベースのチャットボットにはこの能力がありません。

また、倫理面では以下の課題が指摘されています。

プライバシーの問題

患者が入力した深刻な悩みや個人情報が、AIサービスのデータとしてどう扱われるのか。

医療情報の取り扱い基準(たとえば米国のHIPAAや日本の個人情報保護法)との整合性が問われています。

アルゴリズムのバイアス

AIの学習データに偏りがあると、特定の文化的背景や少数派の患者に対して不適切な応答をする可能性があります。

インフォームドコンセント

患者はAIと対話していることを明確に認識しているか、AIの限界を理解した上で利用しているか。

臨床的妥当性の検証不足

多くのLLMベースのメンタルヘルスツールはまだ開発初期段階にあり、厳密な臨床試験による検証が不足しています。

Harvard Medical School では、こうした課題に対応するため、デジタルメンタルヘルスの継続教育プログラムを提供し始めています。

臨床医がAIツールを批判的に評価し、責任を持って患者を導くための知識が求められているのです。

臨床医はAIチャットボットをどう臨床に統合すべきか?

AIを臨床現場に取り入れる最も現実的なアプローチは「ハイブリッドモデル」です。

これは、人間の臨床医が治療の主軸を担いつつ、AIが補助的な役割を果たす協働体制のことです。

たとえば、セラピストが対面セッションで治療方針を立て、セッションの間の期間にAIチャットボットが宿題の進捗確認やスキル練習の支援を行う、という使い分けです。

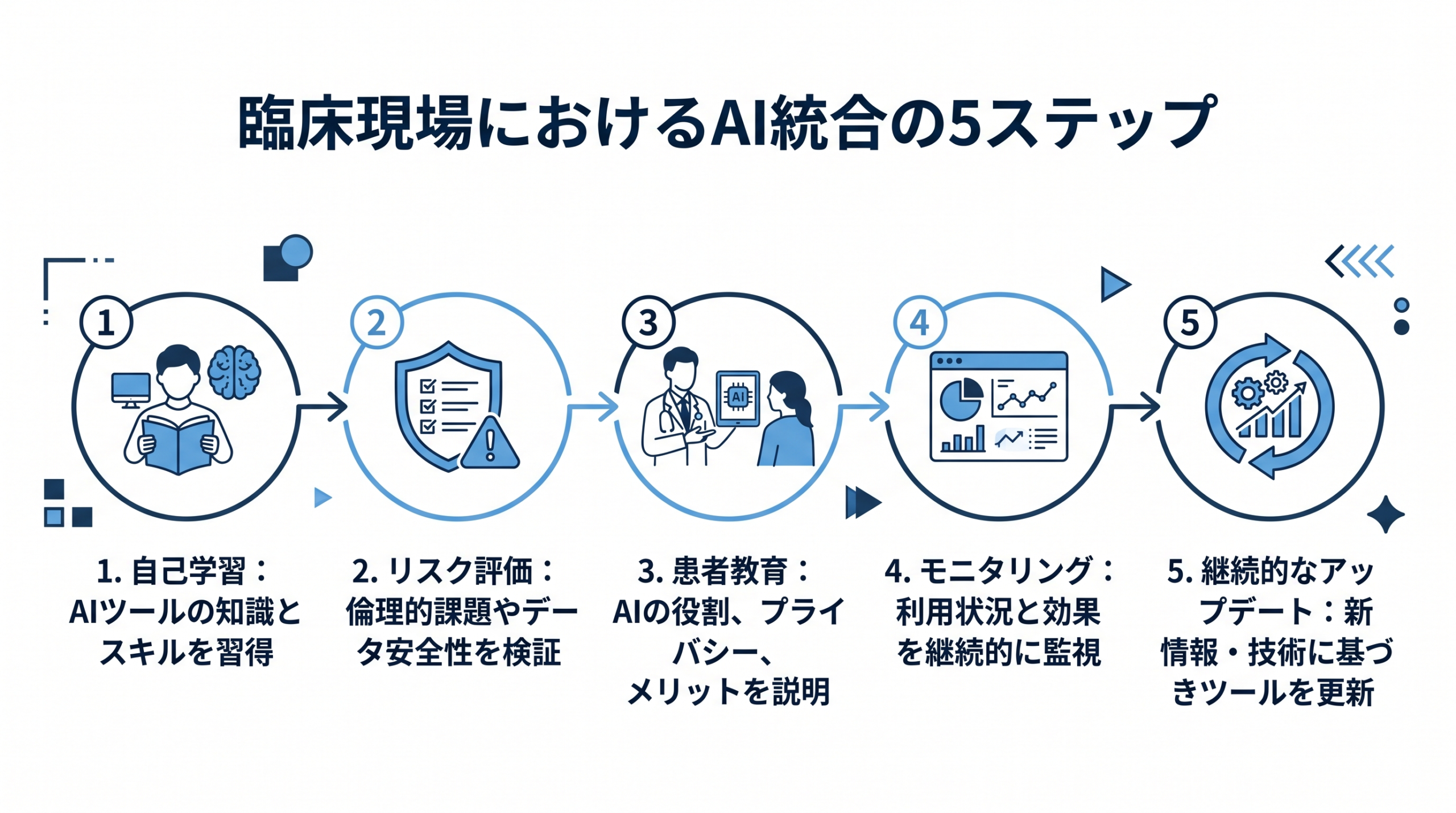

具体的な統合ステップとしては、以下のような段階が考えられます。

- 自己学習:まず臨床家自身がAIチャットボットを実際に使ってみる。Therabotなどのツールを体験し、応答の質や限界を肌で感じる。

- リスク評価:担当患者のうち、どのケースでAI補助が有効か、どのケースでは禁忌(使うべきでない)かを判断する。自殺リスクの高い患者や急性期の患者にはAI単独の対応を避ける。

- 心理教育:患者にAIツールの仕組みと限界を説明し、インフォームドコンセントを得る。「このツールはセラピストの代わりではなく、補助ツールです」と明確に伝える。

- モニタリング体制の構築:患者のAI利用状況を定期的に確認し、不適切な依存や悪影響がないかをチェックする仕組みをつくる。

- 継続的なアップデート:AI技術は急速に進化するため、最新のエビデンスやガイドラインを継続的に学ぶ。学会や継続教育プログラムへの参加が有効。

NPRの2026年4月の報道によれば、AI導入に対する医療現場の反応は「恐れと反発、そして熱意」が入り混じっています。

重要なのは、AIを「脅威」ではなく「新しい協働パートナー」として位置づけ、段階的に導入を進めることです。

まとめ:チャットボット時代に臨床家が今日からできること

AIチャットボットはメンタルヘルスケアの風景を大きく変えつつあります。

臨床家がこの変化に適応するために、以下の要点を押さえておきましょう。

- AIリテラシーは臨床能力の新しい柱:チャットボットリテラシー、AI使用の評価、安全性、倫理、AI統合を意識的に強化しましょう。

- AIは代替ではなく協働のツール:人間の臨床家だからこそ可能な共感的理解・非言語的サインの察知・治療関係の構築は、AIには置き換えられません。

- まず自分で体験する:臨床家自身がAIチャットボットを使ってみることが、理解の第一歩です。

- 安全性と倫理は常に最優先:特に自殺リスクの評価や個人情報保護の観点で、AIの限界を十分に認識した上で活用しましょう。

- 継続的な学びが不可欠:AI技術は急速に進化しています。Harvard Medical Schoolの継続教育プログラムなど、信頼できるリソースを活用して知識をアップデートし続けましょう。

技術の進化は止まりませんが、患者の安全と利益を最優先にする姿勢は、どんな時代でも変わらないですよね。

【参考文献】

Clinician Competence in the Age of Chatbots | Psychiatric Times

【あわせて読みたい】

![A clean, modern flat illustration showing two overlapping circles (Venn diagram style) in soft blue and sky blue, representing ASD and ADHD. Inside the overlap, a small human silhouette stands with puzzle pieces gently floating around. White background, minimalist design, healthcare-themed, calming blue palette, no text. [/image-prompt]](https://tetsuyas-mindpalace.com/wp-content/uploads/2026/04/3b5cc22e7a8feb17154e00f876f2cf38-150x150.png)

コメントを残す